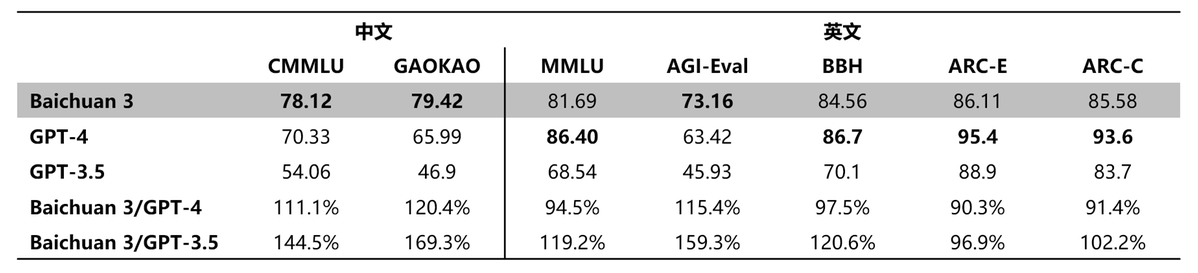

1月29日,百川智能发布超千亿参数的大语言模型Baichuan 3。在多个权威通用能力评测如CMMLU、GAOKAO和AGI-Eval中,Baichuan 3都展现了出色的能力。

基础能力全面提升

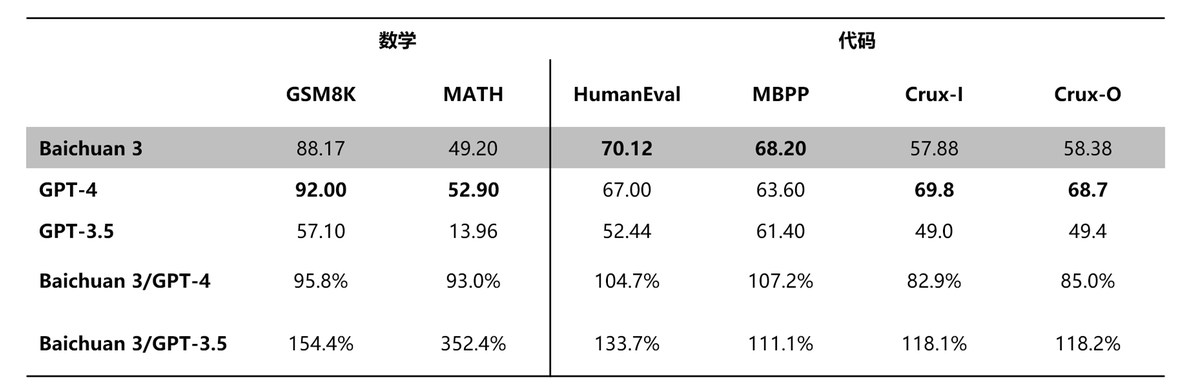

Baichuan 3在多个英文评测中表现出色,达到接近GPT-4的水平。而在CMMLU、GAOKAO、HumanEval和MBPP等多个中文评测榜单上,更是超越GPT-4展现了其在中文任务上的优势。

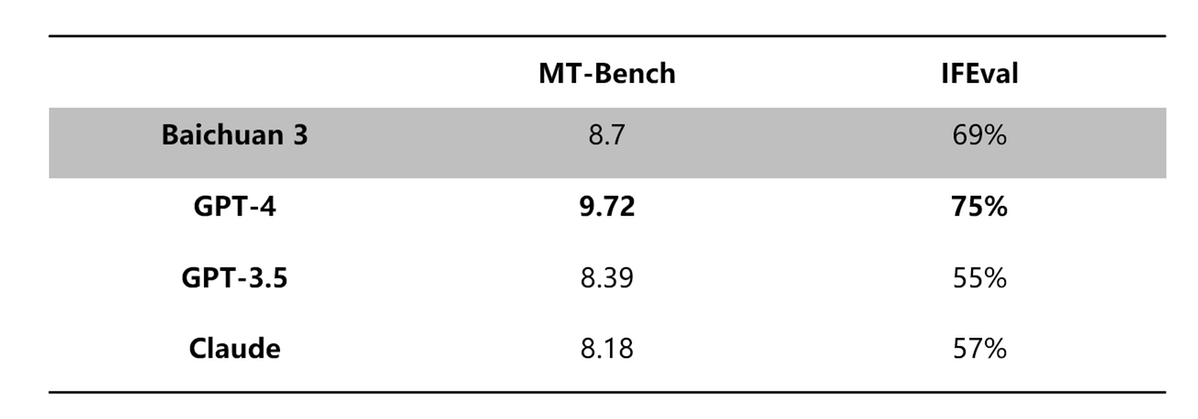

此外,在MT-Bench、IFEval等对齐榜单的评测中,Baichuan 3处于行业领先水平。

与百亿、几百亿级别参数模型训练不同,超千亿参数模型在训练过程中对高质量数据,训练稳定性、训练效率的要求都高出几个量级。为更好解决相关问题,百川智能在训练过程中针对性地提出了“动态数据选择”、“重要度保持”以及“异步CheckPoint存储”等多种创新技术手段及方案,有效提升了Baicuan 3的各项能力。

高质量数据方面,百川智能设计了一套基于因果采样的动态训练数据选择方案,该方案能够在模型训练过程中动态地选择训练数据,极大提升数据质量。

训练稳定性方面,百川智能提出了“重要度保持”(Salience-Consistency)的渐进式初始化方法,用以保证模型训练初期的稳定性。并且优化了模型训练过程的监控方案,在梯度、Loss等指标上引入了参数“有效秩”的方法来提早发现训练过程中的问题,极大加速对训练问题的定位,确保了最后模型的收敛效果。

训练效率方面,百川智能针对超千亿参数模型的并行训练问题进行了一系列优化,如高度优化的RoPE, SwiGLU计算算子;在数据并行中实现参数通信与计算的重叠,以及在序列并行中实现激活值通信与计算的重叠,从而有效降低了通信时间的比重;在流水并行中引入了将激活值卸载至GPU的技术,解决了流水并行中显存占用不均的问题,减少了流水并行的分段数量并显著降低了空泡率。

医疗数据集Token数超千亿

为了给Baichuan3注入丰富的医疗知识,百川智能在模型预训练阶段构建了超过千亿Token的医疗数据集,包括医学研究文献、真实的电子病历资料、医学领域的专业书籍和知识库资源、针对医疗问题的问答资料等。该数据集涵盖了从理论到实际操作,从基础理论到临床应用等各个方面的医学知识,确保了模型在医疗领域的专业度和知识深度。

针对医疗知识激发的问题,百川智能在推理阶段针对Prompt做了系统性的研究和调优,通过准确的描述任务、恰当的示例样本选择,让模型输出更加准确以及符合逻辑的推理步骤,最终不仅提升了Baichuan 3在多项医疗考试上的成绩,并且在真实的医疗问答场景下也能给用户提供更精准、细致的反馈。

突破“迭代式强化学习”技术

语义理解和文本生成,作为大模型最基础的底层能力,是其他能力的支柱。为提升这两项能力,业界进行了大量探索和实践,OpenAI、Google以及Anthropic等引入的RLHF(基于人类反馈的强化学习)和RLAIF(基于AI反馈的强化学习)便是其中的关键技术。

基于强化学习对齐后的模型不仅可以更精准地理解用户指令,尤其是多约束以及多轮对话下的指令,还能进一步提升生成内容的质量。但是在大模型中充分发挥强化学习的作用不仅需要稳定且高效的强化学习训练框架和高质量的优质偏序数据,还需要在“探索与利用”两者间进行平衡,实现模型能力持续爬坡。

对于以上问题,百川智能进行了深入研究,并给出了针对性的解决方案。强化学习训练框架方面,百川智能自研了训练推理双引擎融合、多模型并行调度的PPO训练框架,能够很好支持超千亿模型的高效训练,训练效率相比业界主流框架提升400%。偏序数据方面,百川智能创新性的采用了RLHF与RLAIF结合的方式来生成高质量优质偏序数据,在数据质量和数据成本之间获得了更好的平衡。在此基础上,对于“探索与利用”这一根本挑战,百川智能通过PPO探索空间与Reward Model评价空间的同步升级,实现“迭代式强化学习”(iterative RLHF&RLAIF)。基于强化学习的版本爬坡,可以在SFT的基础上进一步发挥底座模型的潜力,让Baichuan 3的语义理解和生成创作能力大幅提升。

作为参数规模超过千亿的大语言模型,Baichuan 3不仅英文效果达到接近GPT-4的水平,还在多项通用中文任务的表现上实现了对GPT-4的超越,是百川智能的全新里程碑。Baichuan 3全面的通用能力以及在医疗领域的强大表现,将为百川智能打造“超级应用”,把大模型技术落地到诸多复杂应用场景提供有力支撑。